Si existe un lugar que las personas utilizan día a día para hacer catarsis y expresar sus emociones, mucho más que en terapia, esas son las redes sociales. Plataforma de uso masivo que utilizamos todos los días para contar, comentar y compartir lo bueno, malo y mediocre que nos ocurre día a día.

Justamente, esta adicción ególatra que la sociedad encontró en el consumo de la vida privada de los demás y el disfrute de la masificación de la propia, convierte a cada red social en una base de datos muy interesante, pudiendo obtener patrones de comportamiento genéricos, y otros datos útiles para los mercados en general.

Así, en sus comienzos, toda la actividad realizada en las redes sociales se utilizó a modo de espectro de estudio y análisis, con fines claramente comerciales. La publicidad en estas plataformas, como Facebook, se perfeccionó, y eso una de las herramientas de marketing más importantes que utilizan hoy las empresas, por su especificidad y bajo costo.

Pero, tanto capitalismo puede tener también su lado provechoso. Y es que, en base a estos sistemas que analizan los patrones de comportamiento, la red social de Mark Zuckerberg, Facebook, puede anunciar el lanzamiento de un software de inteligencia artificial que realiza una detección proactiva de actitudes y comportamientos indicadores de suicidio en sus usuarios.

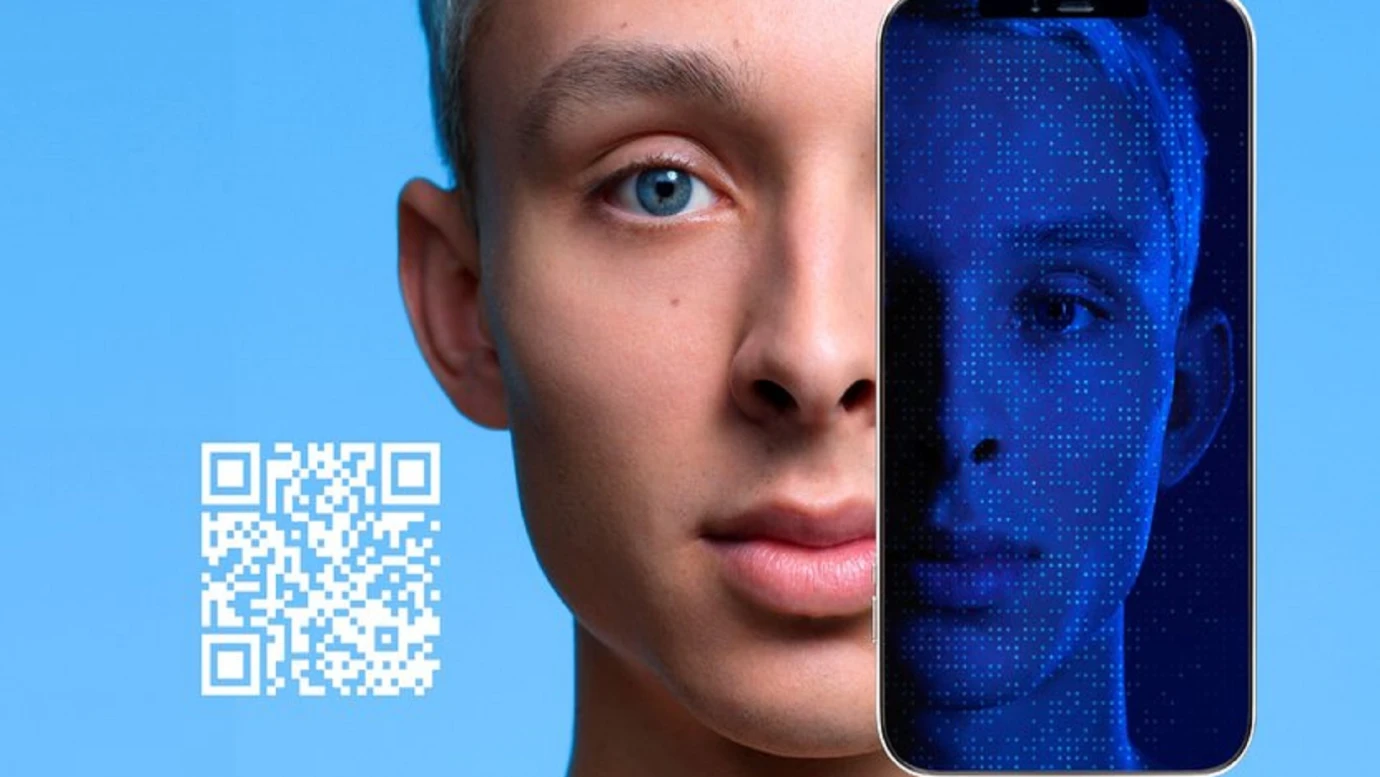

¿Cómo puede Facebook detectar estos comportamientos? La detección se realiza a través de bot, desarrollos de software complejos que permiten leer y dar sentido a los textos y expresiones de cada usuario. Estos bots, como se menciona arriba, fueron inicialmente utilizados con fines comerciales o, incluso, políticos.

Pero, ¿qué puede hacer Facebook para prevenir el hecho? Una vez detectado el comportamiento, o indicio, suicida del usuario, la red social enviará recursos de salud mental tanto al perfil detectado como al de sus amigos. En algunos casos, Facebook se pondrá directamente en contacto con los servicios de emergencia, para que se encarguen del tema, derivando la problemática en manos especializadas.

"Facebook es un lugar donde los amigos y familiares ya están conectados, y podemos ayudar a reunir a una persona en apuros con personas que pueden apoyarlos", comentó el vicepresidente de Gestión de Productos de Facebook, Guy Rosen. "Nuestro enfoque fue desarrollado en colaboración con organizaciones de salud mental como Save.org, National Suicide Prevention Lifeline y Forefront Suicide Prevention y con aportes de personas que han tenido experiencia personal al pensar o intentar suicidarse", sumó.

Si bien este servicio ya estaba habilitado en Estados Unidos, a modo de prueba masiva, hoy Mark Zuckerberg anuncia la expansión a nivel global, exceptuando a la Unión Europea, donde las leyes que regulan la privacidad de las personas, limitan el uso de esta tecnología.

El propio Mark Zuckerberg comentó en su perfil de Facebook respecto de este avance tan significativo en tecnología de inteligencia artificial, y declaró: "en el futuro, la IA será capaz de comprender más de los sutiles matices del lenguaje y tendrá la capacidad de identificar diferentes temas más allá del suicidio, incluyendo otras expresiones de bullying y manifestaciones de odio".

Cabe destacar, en tiempos en los que cada avance tiene su origen en cuestiones comerciales y políticas, que este tipo de desarrollos puedan también mejorar la vida de los usuarios, y personas en general, desde el lado de la salud y el provecho como individuos y sociedades.

Facebook lanza, entonces, una herramienta que –se espera- salve la vida de muchas personas, realizando una detección proactiva y temprana de los indicadores. Ojalá, muchas otras redes sociales compartan el enfoque de Facebook, y copien este tipo de actitudes.

18/04/2024

18/04/2024 16/04/2024

16/04/2024 16/04/2024

16/04/2024 12/04/2024

12/04/2024 12/04/2024

12/04/2024 09/04/2024

09/04/2024